Линейная регрессия - это способ объяснить связь между зависимой переменной и одной или несколькими объясняющими переменными с помощью прямой линии. Это особый случай регрессионного анализа.

Линейная регрессия была первым типом регрессионного анализа, который был тщательно изучен. Это связано с тем, что модели, которые линейно зависят от неизвестных параметров, легче подгоняются, чем модели, которые нелинейно связаны со своими параметрами. Более того, статистические свойства результирующих оценщиков легче определить.

Линейная регрессия имеет много практического применения. Большинство применений относится к одной из следующих двух широких категорий:

- Линейная регрессия может быть использована для подгонки прогностической модели к набору наблюдаемых значений (данных). Это полезно, если целью является предсказание, или прогнозирование, или уменьшение. После разработки такой модели, если затем дается дополнительное значение X без сопровождающего его значения y, то с помощью подогнанной модели можно сделать прогноз значения y.

- Учитывая переменную y и ряд переменных X1, ..., Xp, которые могут быть связаны с y, анализ линейной регрессии может быть применен для количественного определения силы связи между y и Xj, для оценки того, какая из подмножеств Xj вообще не имеет связи с y, и для определения того, какие подмножества Xj содержат избыточную информацию об y.

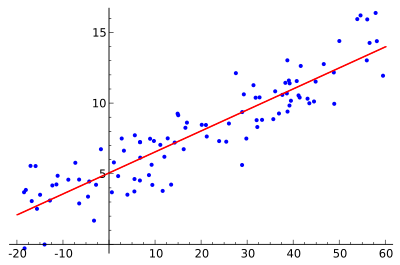

Модели линейной регрессии пытаются сделать вертикальное расстояние между линией и точками данных (например, остатки) как можно меньшим. Это называется "подгонкой линии под данные". Часто модели линейной регрессии пытаются минимизировать сумму квадратов остатков (наименьших квадратов), но существуют и другие способы подгонки. Они включают минимизацию "отсутствия подгонки" в какой-то другой норме (как при регрессии наименьших абсолютных отклонений), или минимизацию оштрафованного варианта функции потерь наименьших квадратов, как при регрессии гребня. Подход по методу наименьших квадратов может также использоваться для подгонки моделей, которые не являются линейными. Как было указано выше, термины "наименьшие квадраты" и "линейная модель" тесно связаны между собой, но не являются синонимами.